10.000 Sterne in 10 Tagen: Reverse Engineering von Claude Mythos

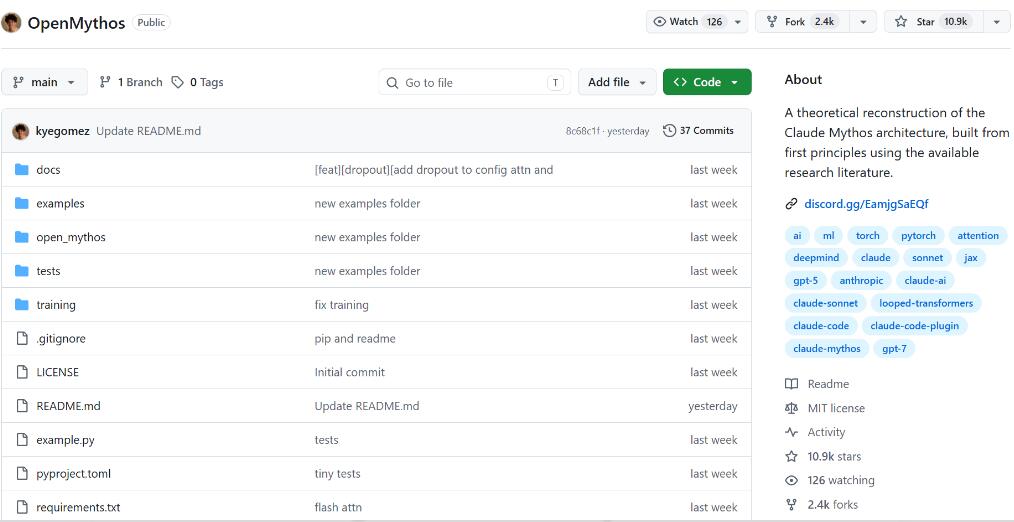

Ein Projekt hat kürzlich auf GitHub für Furore gesorgt. Am 18. April erstellt, erreichte es in nur 10 Tagen über 10.000 Sterne. Das Überraschende? Der Autor, Kye Gomez, ist erst 22 Jahre alt. Das Projekt mit dem Namen OpenMythos ist nur 68 KB groß und implementiert einen Recurrent-Depth Transformer ausschließlich mit PyTorch. Kurz gesagt, es handelt sich um einen theoretischen Architekturnachbau von Anthropics Claude Mythos, basierend auf öffentlich zugänglichen Forschungsarbeiten und Community-Hypothesen. Warum wurde ein theoretisches Rekonstruktionsprojekt so populär? Rückblickend hat das viel mit der Veröffentlichung von Claude Mythos selbst zu tun.

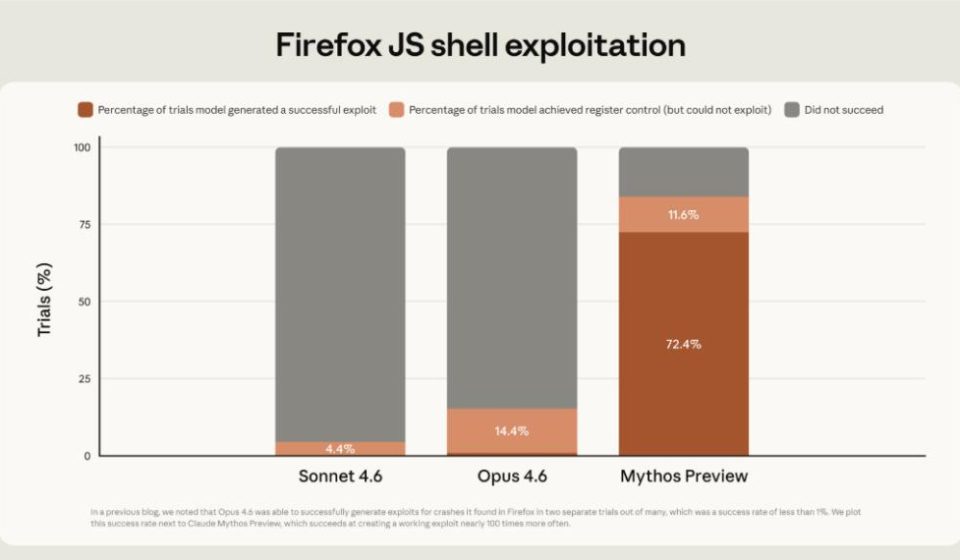

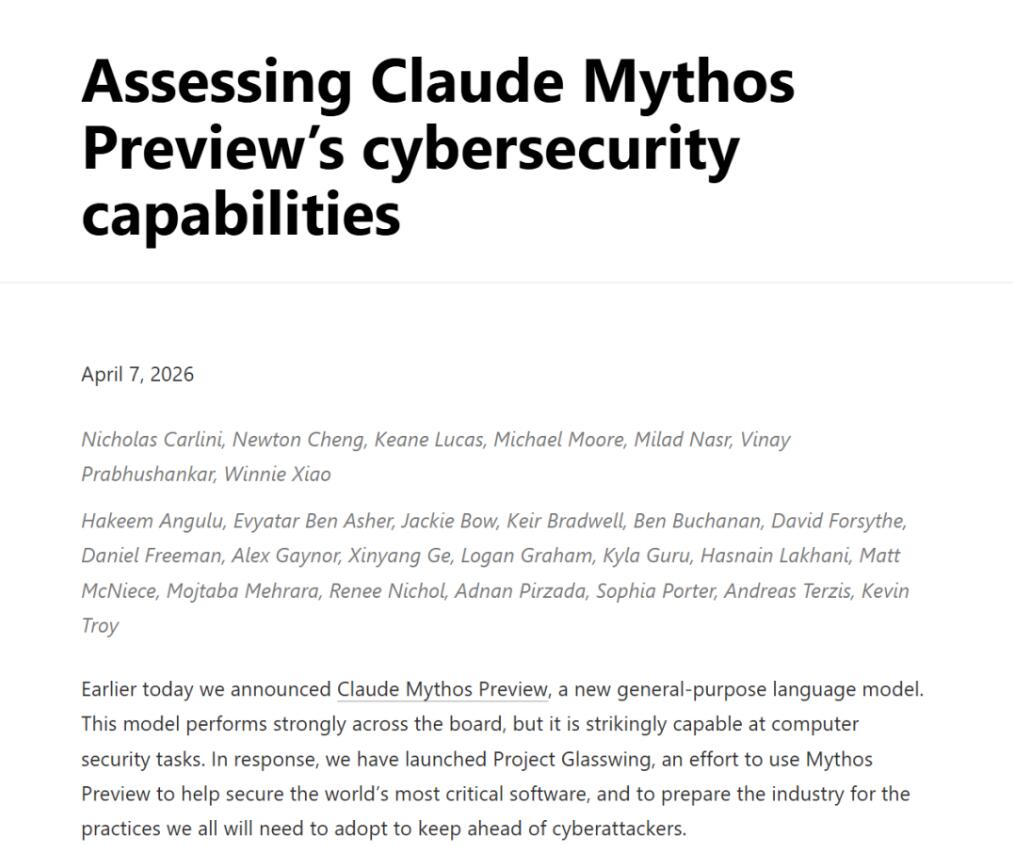

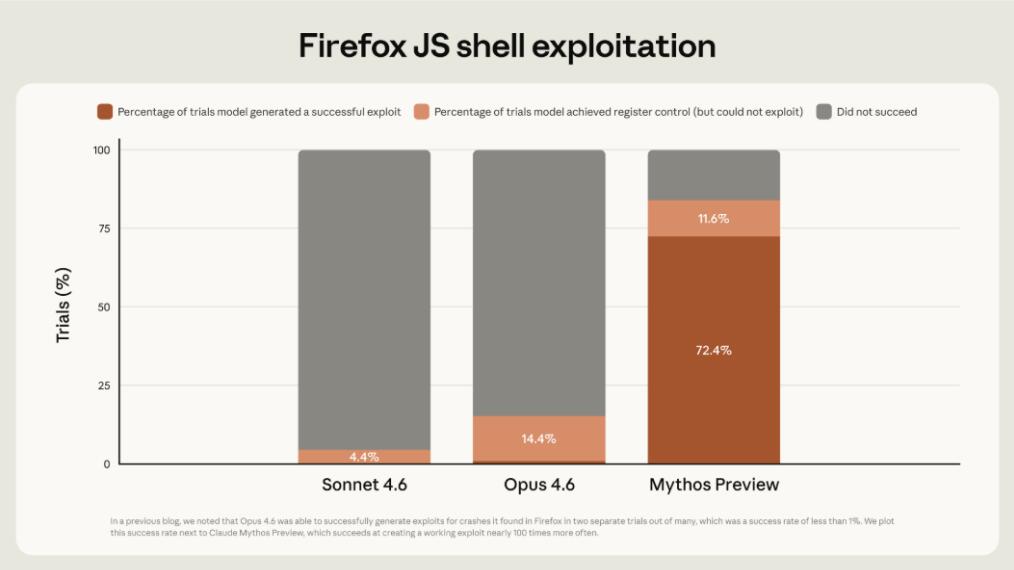

Am 7. April veröffentlichte Anthropic die Claude Mythos Preview. Dies war kein gewöhnliches Model-Update, sondern ein neues, leistungsfähigeres Modell der nächsten Generation, das das aktuelle Flaggschiff Opus übertrifft. Offizielle Daten zeigen, dass es autonom tausende hochriskante Zero-Day-Schwachstellen identifizierte und dabei alle gängigen Betriebssysteme und Webbrowser abdeckte. Im CyberGym-Benchmark erzielte es 83,1 % und übertraf damit fast alle führenden menschlichen Experten im Bereich Cybersicherheit. Mozilla berichtete, dass Mythos 271 Zero-Day-Schwachstellen im Firefox-148-Quellcode entdeckte, die in der Version 150 von Firefox behoben wurden. Doch Anthropic traf eine überraschende Entscheidung: die Veröffentlichung für die Öffentlichkeit abzulehnen, mit Verweis auf Cybersicherheitsrisiken – die Fähigkeit, Schwachstellen zu finden, könnte auch für Angriffe genutzt werden.

Ich habe die von Anthropic offengelegten Schwachstelleninformationen zusammengestellt. Das Modell ist nur etwa 40–48 Partnern über das Project Glasswing zugänglich, darunter wichtige Infrastrukturunternehmen wie Amazon, Apple, Microsoft, Google, CrowdStrike, Cisco und JPMorgan Chase, ausschließlich für defensive Sicherheitsforschung. Diese Entscheidung löste in der Community Debatten aus. Befürworter sahen es als verantwortungsvollen Schritt, während Skeptiker argumentierten, das „Gefahrennarrativ“ könnte zu Marketingzwecken übertrieben sein. Unabhängige Sicherheitsforschungsinstitute reproduzierten Tests mit kleineren Open-Source-Modellen und fanden, dass sie die meisten Analysen nachvollziehen konnten, was die angebliche Einzigartigkeit von Mythos infrage stellte. Es gab auch Berichte, dass von 7.000 Schwachstellen nur etwa 10 kritisch seien. Auch wenn diese Zweifel den Wert von Mythos nicht unbedingt widerlegen, verdeutlichen sie ein zentrales Problem: Anthropic hält alle technischen Details geheim und veröffentlichte nur drei Dokumente – die System Card, das Alignment Risk Update und die Responsible Scaling Policy – ohne die Architektur offenzulegen.

Im Internet wurde heftig spekuliert: Welche Architektur verwendet Mythos wirklich? Modelle wie OpenAIs o1 und DeepSeeks R1 arbeiten, indem sie „Denk-Tokens“ generieren und ihren Denkprozess explizit machen. Aber Mythos ist anders – es führt tiefgehende Schlussfolgerungen intern durch, ohne Zwischenschritte preiszugeben. In diesem Kontext entstand OpenMythos und gewann an Aufmerksamkeit.

Der Autor stellt die Hypothese auf, dass Mythos wahrscheinlich einen Recurrent-Depth Transformer verwendet, bei dem derselbe Satz von Gewichten iterativ wiederverwendet wird. Jede Schleife führt eine Denkiteration im latenten Raum durch, aber es werden keine Zwischenergebnisse nach außen ausgegeben. Das ähnelt dem menschlichen Denken: Zuerst verschaffen wir uns einen groben Überblick, dann denken wir tiefer nach, füllen Lücken aus, verfeinern wiederholt und fassen schließlich die Kernpunkte zusammen. Die endgültige Antwort wirkt knapp, wurde intern aber mehrfach überarbeitet und optimiert. Diese Hypothese ist nicht unbegründet – sie stützt sich auf mehrere aktuelle Forschungsarbeiten, darunter „Loop, Think, & Generalize“ (2026), „Parcae“ (2026) und „Reasoning with Latent Thoughts“ (2025). OpenMythos macht diese Theorien zu ausführbarem Code.

Herkömmliche Transformer führen das Reasoning in einem Durchgang durch: Das Modell verarbeitet die Eingabe über eine feste Anzahl von Schichten und produziert direkt die Ausgabe, ohne iterative Verfeinerung. OpenMythos teilt die Architektur in drei Abschnitte: Prelude, Recurrent Block und Coda. Der rekurrente Block verwendet einen einzigen Satz von Parametern, der wiederholt aufgerufen werden kann. Mit jeder zusätzlichen Schleife wird der interne Zustand aktualisiert, sodass das Modell tiefer und umfassender denken kann. Die Kernformel der Schleife sieht so aus: Bei jeder Iteration wird der ursprüngliche Eingabevektor e wieder eingespiesen. Dies verhindert, dass der verborgene Zustand in tiefen Schleifen abdriftet, ähnlich wie wir während des Nachdenkens regelmäßig das ursprüngliche Problem überprüfen, um nicht abzuschweifen.

Obwohl das Projekt komplex erscheint, erfordert die Installation nur einen Befehl:

pip install open-mythos

Anschließend können Sie ein einfaches Modell in Python erstellen. Für tiefergehendes Reasoning können Sie den Parameter n_loopsanpassen, was jedoch mehr Rechenzeit erfordert. OpenMythos unterstützt auch zwei Aufmerksamkeitsmechanismen: GQA und MLA. Die FFN-Schicht verwendet ein Mixture-of-Experts-Design (MoE), wobei die ursprüngliche monolithische FFN in zahlreiche kleinere Expertenmodule aufgeteilt wird. Während der Inferenz wählt ein Routing-Mechanismus automatisch die Top-k Experten für jedes Token aus, sodass nicht alle Experten ausgeführt werden müssen. Neben den gerouteten Experten bleibt eine kleine Anzahl geteilter Experten stets aktiv, um domänenübergreifendes Allgemeinwissen zu erfassen. Der MoE-Routing-Mechanismus funktioniert wie folgt: Die geteilten Experten verhindern, dass jeder geroutete Experte redundantes Grundwissen wie Grammatik und elementares Reasoning lernt. Das Projekt bietet sieben voreingestellte Konfigurationen von 1B bis 1T Parametern für verschiedene Anforderungen, vom Experimentieren bis zum Produktiveinsatz. Trainingsskripte werden ebenfalls bereitgestellt und unterstützen sowohl Single-GPU- als auch Multi-GPU-distribuiertes Training.

Allerdings hat OpenMythos auch Kontroversen in der Community ausgelöst. Befürworter sehen es als bahnbrechende Arbeit: die erste vollständige Implementierung eines Recurrent-Depth Transformers, basierend auf mehreren Spitzenpapieren, mit ausführbarem PyTorch-Code und Werkzeugen für die Community, um neue Architekturen zu erforschen. Kritiker weisen darauf hin, dass es sich nur um eine Architekturimplementierung ohne vortrainierte Gewichte handelt, die massive Ressourcen für das Training von Grund auf erfordert; es ist ungewiss, ob sie der Claude-Mythos-Architektur wirklich nahekommt; und der Autor Kye Gomez hat eine Geschichte mit der Open-X-Projektreihe, die einige als Marketing für Open-Source-Alternativen zu Closed-Source-Modellen ansehen. Es ist nicht ganz irreführend – die README erklärt deutlich, dass es sich um eine theoretische Rekonstruktion ohne Verbindung zu Anthropic handelt. Aber die Art der Verbreitung… spiegelt die Kontroverse um Claude Mythos selbst wider. Anthropic hat die öffentliche Veröffentlichung von Mythos aus Sicherheitsgründen eingeschränkt, aber Kritiker argumentieren, dass dies die technologische Kluft vergrößern könnte. Unterdessen muss der Wert von OpenMythos durch tatsächliche Trainingsergebnisse validiert werden, nicht nur durch theoretische Behauptungen.

Natürlich hat OpenMythos seine eigenen Grenzen. Ohne vortrainierte Gewichte ist Training von Grund auf nötig, was eine hohe Hürde darstellt. Großskalige Modelle (100B+ Parameter) benötigen verteiltes Training, und die Verarbeitung langer Kontexte (1M Tokens) erfordert erheblichen Speicher. Zwar stabilisiert die LTI-Beschränkung theoretisch das Training und reduziert Schwankungen, doch die praktische Wirksamkeit muss durch umfangreiche Tests bestätigt werden. Außerdem sind mehr Schleifen nicht immer besser – übermäßige Tiefe kann zu Überdenken und Über-Schlussfolgern führen, was letztlich die Vorhersagegenauigkeit beeinträchtigt.

Abschließend ein Gedanke: Früher war die Architektur von Claude Mythos reine Spekulation. Da Anthropic technische Details zurückhält, konnte die Community nur Hinweise aus der System Card zusammensetzen. OpenMythos bedeutet, dass jemand theoretische Arbeiten in ausführbaren Code verwandelt hat, sodass abstrakte Hypothesen überprüfbar werden. Wenn KI-Fähigkeiten einen bestimmten Schwellenwert erreichen, kann die Entscheidung, etwas zu veröffentlichen oder zurückzuhalten, schwieriger sein als die technische Herausforderung selbst. OpenMythos befindet sich noch in einem frühen Stadium, es fehlen vortrainierte Gewichte, und Training von Grund auf ist nötig. Aber die Richtung stimmt – der Community die Chance zu geben, neue Architekturen zu erforschen, anstatt auf offizielle Veröffentlichungen zu warten. Wenn Sie an Recurrent-Depth Transformern interessiert sind, probieren Sie ein Minimalbeispiel aus, um den iterativen Denkprozess zu erleben. Das Projekt ist unter der MIT-Lizenz offen. Sehen Sie sich das GitHub-Repository für den Quellcode und die Dokumentation an.

Projektadresse: https://github.com/kyegomez/OpenMythos