10.000 estrellas en 10 días: Ingeniería inversa de Claude Mythos

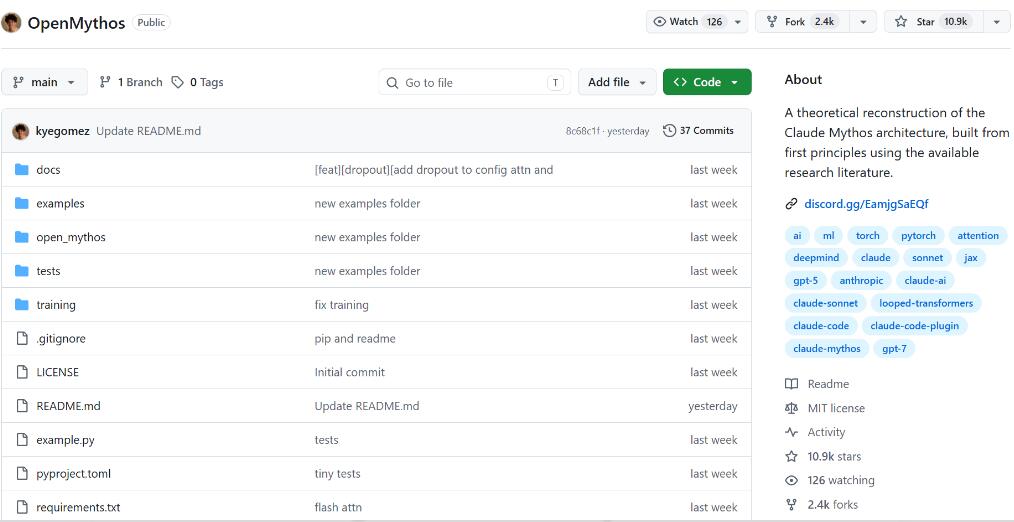

Un proyecto recientemente causó sensación en GitHub. Creado el 18 de abril, alcanzó más de 10.000 estrellas en solo 10 días. ¿Lo más sorprendente? El autor, Kye Gomez, tiene solo 22 años. El proyecto, llamado OpenMythos, tiene un tamaño de apenas 68 KB e implementa un Transformador de Profundidad Recurrente utilizando solo PyTorch. En resumen, es una reconstrucción teórica de la arquitectura de Claude Mythos de Anthropic, basada en artículos públicos e hipótesis de la comunidad. ¿Por qué un proyecto de reconstrucción teórica se volvió tan popular? Mirando hacia atrás, tiene mucho que ver con cómo se lanzó el propio Claude Mythos.

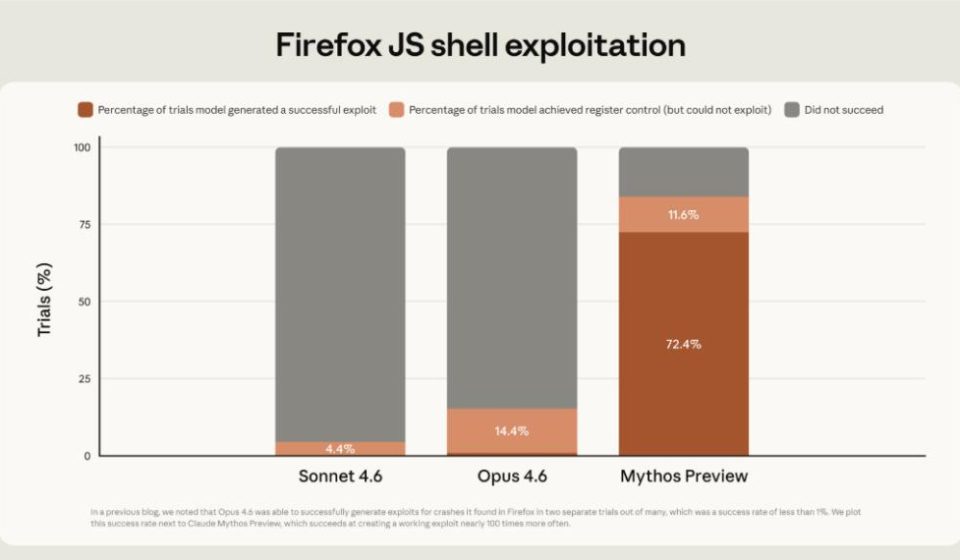

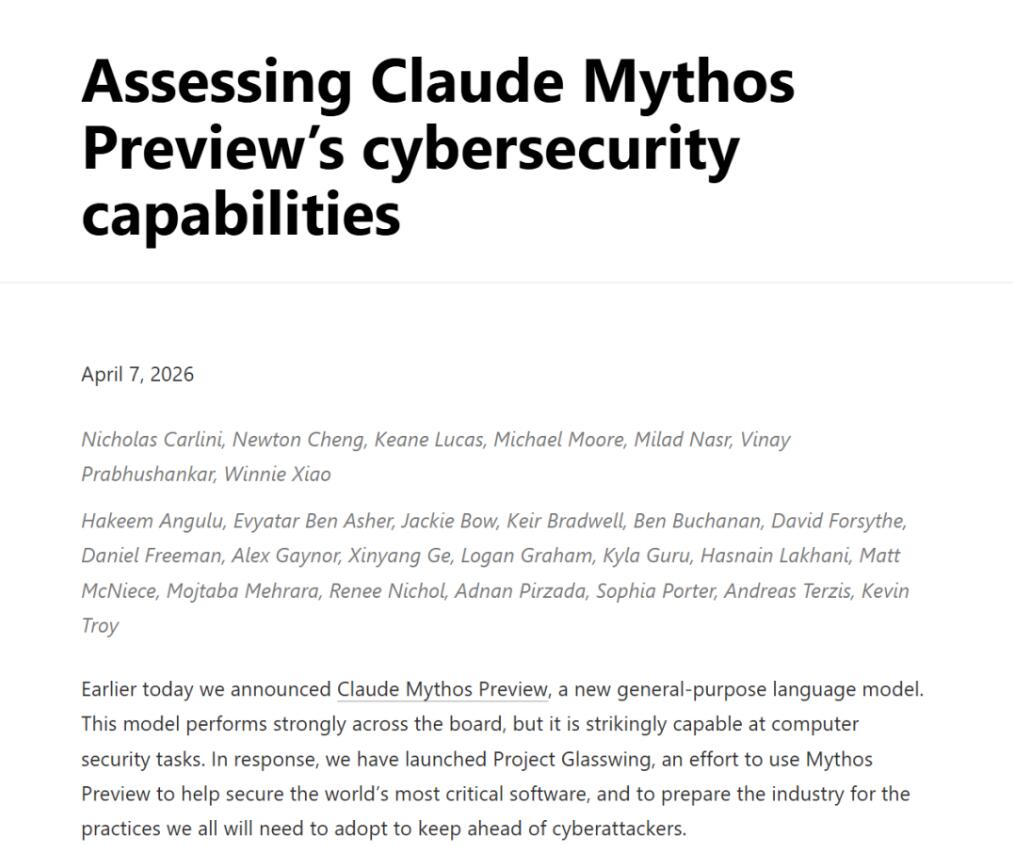

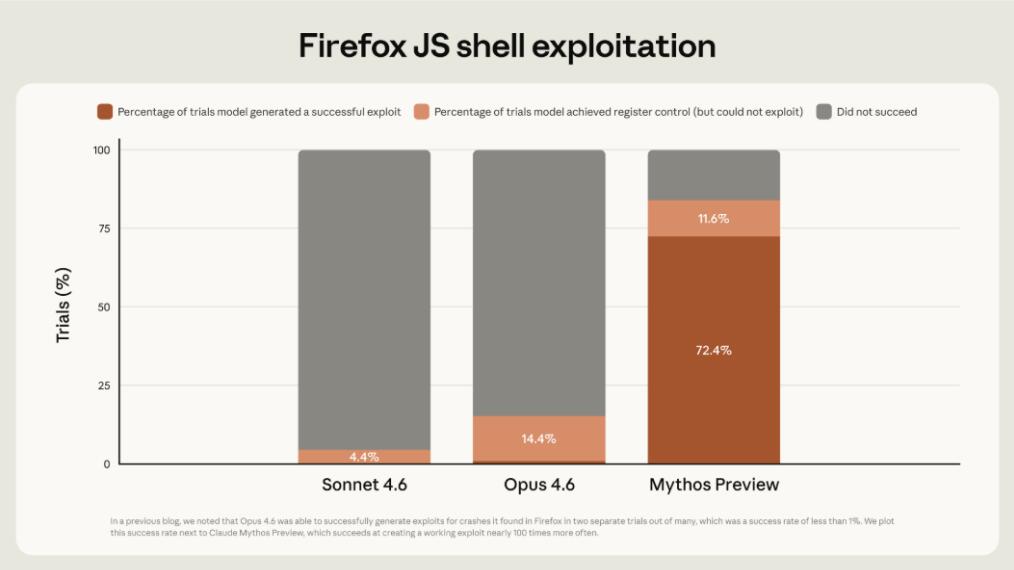

El 7 de abril, Anthropic lanzó Claude Mythos Preview. No fue una actualización de modelo ordinaria, sino un nuevo modelo de generación más potente que el actual buque insignia, Opus. Los datos oficiales muestran que identificó de forma autónoma miles de vulnerabilidades de día cero de alto riesgo, cubriendo todos los sistemas operativos y navegadores web principales. Obtuvo un 83,1 % en el benchmark CyberGym, superando a casi todos los principales expertos humanos en el campo de la ciberseguridad. Mozilla informó que Mythos descubrió 271 vulnerabilidades de día cero en el código fuente de Firefox 148, que se parchearon en la versión 150 de Firefox. Sin embargo, Anthropic tomó una decisión sorprendente: rechazar su lanzamiento público, citando riesgos de ciberseguridad: la capacidad de encontrar vulnerabilidades también podría usarse para ataques.

He recopilado la información de vulnerabilidades divulgada por Anthropic. El modelo solo es accesible para alrededor de 40 a 48 socios a través del proyecto Glasswing, incluidas empresas de infraestructura clave como Amazon, Apple, Microsoft, Google, CrowdStrike, Cisco y JPMorgan Chase, específicamente para investigación de seguridad defensiva. Esta decisión generó debate en la comunidad. Los partidarios la consideraron una medida responsable, mientras que los escépticos argumentaron que la «narrativa del peligro» podría estar exagerada con fines de marketing. Instituciones de investigación de seguridad independientes reprodujeron pruebas utilizando modelos de código abierto más pequeños y descubrieron que podían recuperar la mayor parte de los análisis, cuestionando si la singularidad de Mythos estaba sobrestimada. También hubo informes de que, de 7.000 vulnerabilidades, solo unas 10 serían críticas. Aunque estas dudas pueden no anular el valor de Mythos, destacan un problema clave: Anthropic mantuvo todos los detalles técnicos en secreto, publicando solo tres documentos: la System Card, la Actualización de Riesgo de Alineación y la Política de Escalado Responsable, sin revelar el diseño de la arquitectura.

Hubo mucha especulación en línea: ¿qué arquitectura utiliza realmente Mythos? Modelos como el o1 de OpenAI y el R1 de DeepSeek funcionan generando «tokens de pensamiento», haciendo explícito su proceso de razonamiento. Pero Mythos es diferente: realiza un razonamiento profundo internamente, sin revelar pasos intermedios. Es en este contexto que surgió OpenMythos y ganó tracción.

El autor plantea la hipótesis de que Mythos probablemente utiliza un Transformador de Profundidad Recurrente, donde el mismo conjunto de pesos se reutiliza de manera iterativa. Cada bucle realiza una iteración de razonamiento en el espacio latente, pero no se muestran resultados intermedios externamente. Esto se asemeja a cómo piensan los humanos: primero captamos la idea general, luego profundizamos, llenamos vacíos, refinamos repetidamente y finalmente consolidamos y resumimos los puntos clave. La respuesta final parece concisa, pero internamente ha sido pulida y optimizada varias veces. Esta hipótesis no es infundada: hace referencia a varios artículos recientes, incluidos «Loop, Think, & Generalize» (2026), «Parcae» (2026) y «Reasoning with Latent Thoughts» (2025). OpenMythos convierte estas teorías en código ejecutable.

Los Transformers tradicionales realizan el razonamiento en una sola pasada: el modelo procesa la entrada a través de un número fijo de capas y produce directamente la salida, sin refinamiento iterativo. OpenMythos divide la arquitectura en tres segmentos: Preludio, Bloque Recurrente y Coda. El bloque recurrente utiliza un solo conjunto de parámetros que puede invocarse repetidamente. Con cada bucle adicional, se actualiza el estado interno, permitiendo que el modelo piense más profunda y completamente. La fórmula central del bucle es así: en cada iteración, la entrada original e se reinyecta. Esto evita que el estado oculto se desvíe en bucles profundos, similar a cómo revisamos periódicamente el problema original durante nuestra reflexión para no desviarnos.

Aunque el proyecto parece complejo, la instalación requiere solo un comando:

pip install open-mythos

Luego puedes crear un modelo simple en Python. Para un razonamiento más profundo, puedes ajustar el parámetro n_loops, aunque requiere más tiempo de cómputo. OpenMythos también admite dos mecanismos de atención: GQA y MLA. La capa FFN adopta un diseño de Mezcla de Expertos (MoE), dividiendo la FFN monolítica original en numerosos módulos expertos más pequeños. Durante la inferencia, un mecanismo de enrutamiento selecciona automáticamente a los k mejores expertos para cada token, evitando ejecutar a todos. Además de los expertos enrutados, un pequeño número de expertos compartidos permanece siempre activo, capturando conocimiento general entre dominios. El mecanismo de enrutamiento MoE funciona así: los expertos compartidos evitan que cada experto enrutado aprenda redundancias básicas como gramática y razonamiento elemental. El proyecto proporciona siete configuraciones preestablecidas, desde 1B hasta 1T de parámetros, atendiendo diversas necesidades, desde experimentación hasta producción. También se proporcionan scripts de entrenamiento, compatibles con entrenamiento en una sola GPU y distribuido en múltiples GPU.

Sin embargo, OpenMythos también generó controversia en la comunidad. Los partidarios lo ven como un trabajo innovador: la primera implementación completa de un Transformador de Profundidad Recurrente, basada en múltiples artículos de primer nivel, proporcionando código PyTorch ejecutable y herramientas para que la comunidad explore nuevas arquitecturas. Los críticos señalan que es solo una implementación arquitectónica sin pesos preentrenados, que requiere recursos masivos para entrenar desde cero; es incierto si realmente se aproxima a la arquitectura de Claude Mythos; y el autor, Kye Gomez, tiene antecedentes con la serie de proyectos Open-X, que algunos ven como marketing de alternativas de código abierto a modelos propietarios. No es exactamente engañoso: el README aclara que es una reconstrucción teórica sin afiliación con Anthropic. Pero la forma en que se difundió… hace eco a la controversia en torno al propio Claude Mythos. Anthropic restringió el lanzamiento público de Mythos por seguridad, pero los críticos argumentan que esto puede ampliar la brecha tecnológica. Mientras tanto, el valor de OpenMythos necesita validación mediante resultados de entrenamiento reales, no solo afirmaciones teóricas.

Por supuesto, OpenMythos tiene sus propias limitaciones. Sin pesos preentrenados, requiere entrenamiento desde cero, lo que es una barrera alta. Los modelos a gran escala (100B+ parámetros) necesitan entrenamiento distribuido, y manejar contextos largos (1M tokens) demanda memoria sustancial. Aunque la restricción LTI teóricamente estabiliza el entrenamiento y reduce fluctuaciones, su efectividad práctica debe confirmarse con pruebas exhaustivas. Además, más bucles no siempre es mejor: una profundidad excesiva puede llevar a sobrepensar y sobre-razonar, perjudicando finalmente la precisión predictiva.

Finalmente, una reflexión: anteriormente, descubrir la arquitectura de Claude Mythos era pura especulación. Con Anthropic reteniendo detalles técnicos, la comunidad solo podía reunir pistas de la System Card. OpenMythos representa a alguien transformando trabajos teóricos en código ejecutable, haciendo comprobables hipótesis abstractas. Cuando las capacidades de IA alcanzan cierto umbral, la decisión de publicar o retener puede ser más difícil que el desafío técnico en sí. OpenMythos aún está en sus primeras etapas, carece de pesos preentrenados y requiere entrenamiento desde cero. Pero la dirección es correcta: dar a la comunidad la oportunidad de explorar nuevas arquitecturas en lugar de esperar lanzamientos oficiales. Si te interesan los Transformadores de Profundidad Recurrente, prueba ejecutar un ejemplo mínimo para experimentar el razonamiento iterativo. El proyecto es abierto bajo licencia MIT. Consulta el repositorio de GitHub para el código fuente y la documentación.

Dirección del proyecto: https://github.com/kyegomez/OpenMythos