10 000 Stars en 10 jours : Rétro-ingénierie de Claude Mythos

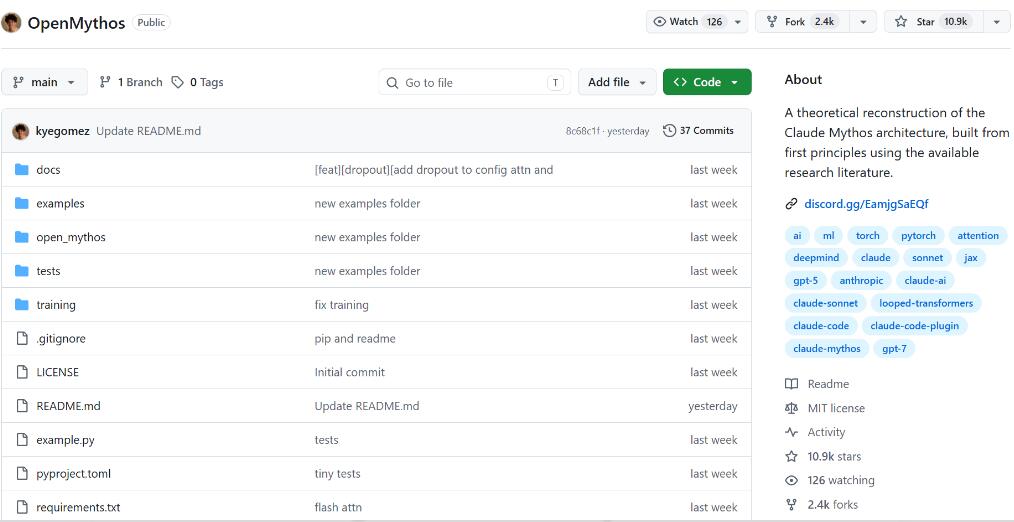

Un projet a récemment fait sensation sur GitHub. Créé le 18 avril, il a atteint plus de 10 000 étoiles en seulement 10 jours. Le plus surprenant ? L’auteur, Kye Gomez, n’a que 22 ans. Le projet, nommé OpenMythos, ne pèse que 68 Ko et implémente un Recurrent-Depth Transformer en utilisant uniquement PyTorch. En résumé, il s’agit d’une reconstruction théorique de l’architecture de Claude Mythos d’Anthropic, basée sur des articles publics et des hypothèses communautaires. Pourquoi un projet de reconstruction théorique est-il devenu si populaire ? En y regardant de plus près, cela est largement dû à la manière dont Claude Mythos lui-même a été publié.

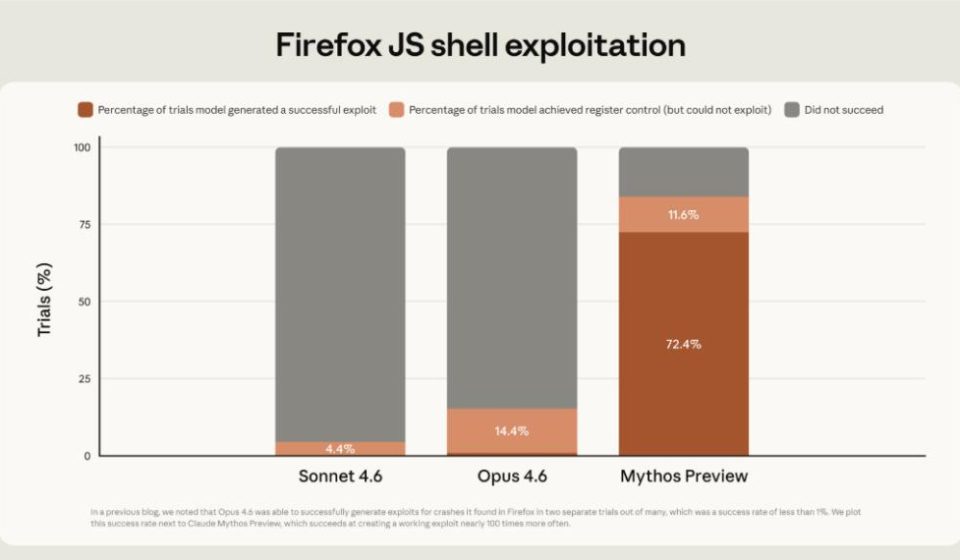

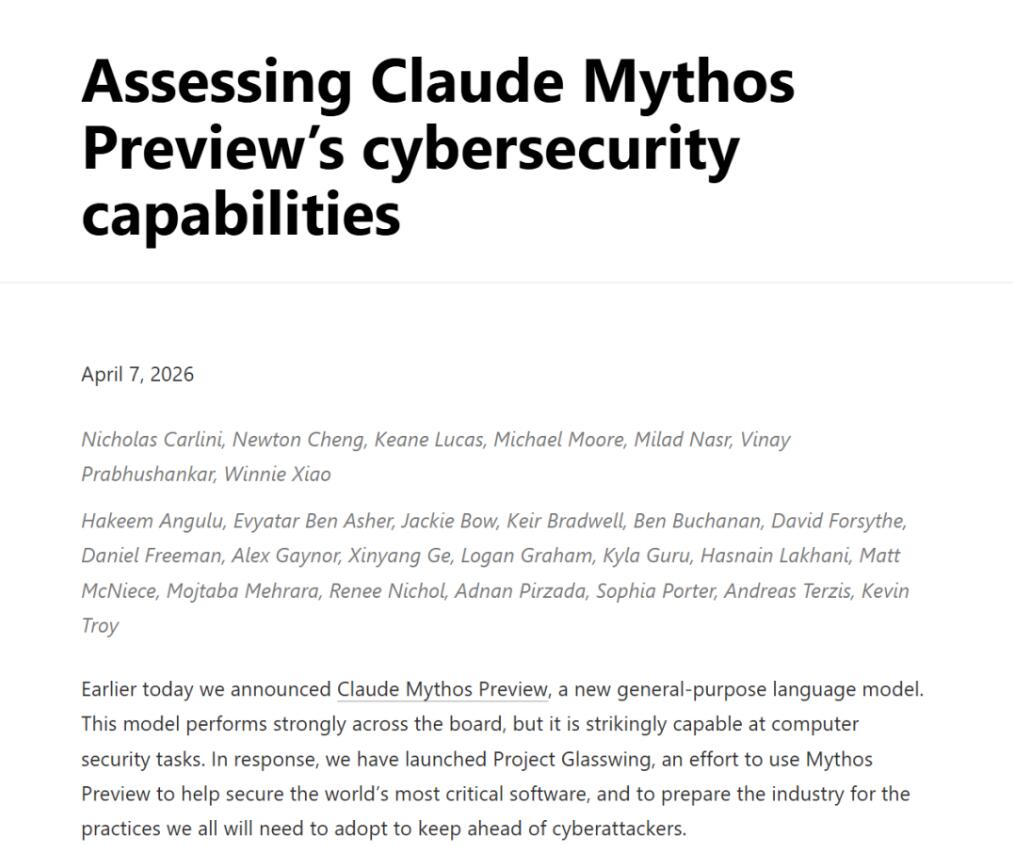

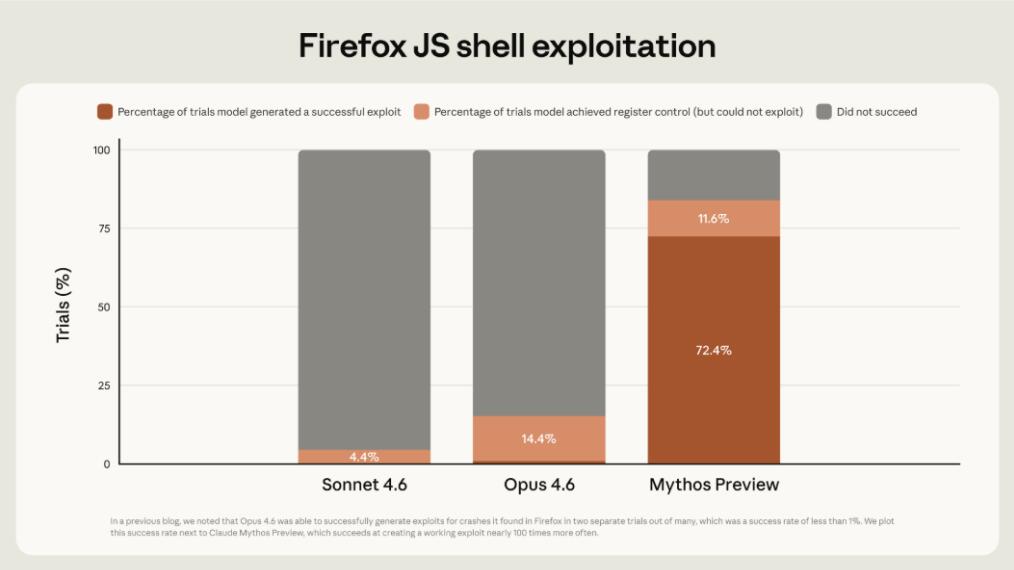

Le 7 avril, Anthropic a publié Claude Mythos Preview. Ce n’était pas une simple mise à jour de modèle, mais un nouveau modèle de génération plus puissant que l’actuel fleuron, Opus. Les données officielles montrent qu’il a identifié de manière autonome des milliers de vulnérabilités zero-day à haut risque, couvrant tous les systèmes d’exploitation et navigateurs web grand public. Il a obtenu un score de 83,1 % au benchmark CyberGym, surpassant presque tous les meilleurs experts humains dans le domaine de la cybersécurité. Mozilla a rapporté que Mythos a découvert 271 vulnérabilités zero-day dans le code source de Firefox 148, qui ont été corrigées dans la version 150 de Firefox. Cependant, Anthropic a pris une décision surprenante : refuser de le publier au public, invoquant des risques de cybersécurité – la capacité à trouver des vulnérabilités pouvant également être utilisée pour des attaques.

J’ai compilé les informations sur les vulnérabilités divulguées par Anthropic. Le modèle n’est accessible qu’à environ 40–48 partenaires via le projet Glasswing, notamment des entreprises d’infrastructure clés comme Amazon, Apple, Microsoft, Google, CrowdStrike, Cisco et JPMorgan Chase, spécifiquement pour la recherche en sécurité défensive. Cette décision a suscité des débats dans la communauté. Les partisans y voient une démarche responsable, tandis que les sceptiques estiment que le « récit du danger » pourrait être exagéré à des fins marketing. Des institutions de recherche en sécurité indépendantes ont reproduit des tests en utilisant des modèles open source plus petits et ont constaté qu’elles pouvaient retrouver la majeure partie des analyses, remettant en question l’unicité supposée de Mythos. Des rapports indiquent également que sur 7 000 vulnérabilités, seulement une dizaine seraient critiques. Si ces doutes n’invalident pas nécessairement la valeur de Mythos, ils soulignent au moins un problème : Anthropic a gardé tous les détails techniques confidentiels, ne publiant que trois documents – la System Card, l’Alignment Risk Update et la Responsible Scaling Policy – sans divulguer la conception de l’architecture.

Les spéculations en ligne ont été nombreuses : quelle architecture utilise réellement Mythos ? Des modèles comme l’o1 d’OpenAI et le R1 de DeepSeek fonctionnent en générant des « jetons de réflexion », rendant leur processus de raisonnement explicite. Mais Mythos est différent – il effectue un raisonnement profond en interne, sans révéler les étapes intermédiaires. C’est dans ce contexte qu’OpenMythos est apparu et a gagné en popularité.

L’auteur émet l’hypothèse que Mythos utilise probablement un Recurrent-Depth Transformer, où le même ensemble de poids est réutilisé de manière itérative. Chaque boucle effectue une itération de raisonnement dans l’espace latent, mais aucun résultat intermédiaire n’est produit en externe. Cela ressemble à la façon dont les humains réfléchissent : d’abord, on saisit l’idée générale, puis on affine, on comble les lacunes, on peaufine à plusieurs reprises, et enfin on consolide et résume les points clés. La réponse finale semble concise, mais en interne, elle a été polie et optimisée à plusieurs reprises. Cette hypothèse n’est pas infondée – elle s’appuie sur plusieurs articles récents, dont « Loop, Think, & Generalize » (2026), « Parcae » (2026) et « Reasoning with Latent Thoughts » (2025). OpenMythos transforme ces théories en code exécutable.

Les Transformers traditionnels effectuent un raisonnement en une seule passe : le modèle traite l’entrée à travers un nombre fixe de couches et produit directement la sortie, sans raffinement itératif. OpenMythos divise l’architecture en trois segments : Prelude, Recurrent Block et Coda. Le bloc récurrent utilise un seul ensemble de paramètres pouvant être invoqué à plusieurs reprises. À chaque boucle supplémentaire, l’état interne est mis à jour, permettant au modèle de réfléchir plus profondément et plus complètement. La formule centrale de la boucle ressemble à ceci : à chaque itération, l’entrée originale e est réinjectée. Cela empêche l’état caché de dériver dans les boucles profondes, un peu comme lorsque nous revoyons périodiquement le problème original pendant notre réflexion pour ne pas nous en éloigner.

Bien que le projet semble complexe, l’installation ne nécessite qu’une seule commande :

pip install open-mythos

Vous pouvez ensuite créer un modèle simple en Python. Pour un raisonnement plus profond, vous pouvez ajuster le paramètre n_loops, même si cela nécessite plus de temps de calcul. OpenMythos prend également en charge deux mécanismes d’attention : GQA et MLA. La couche FFN adopte une conception Mixture of Experts (MoE), divisant la FFN monolithique d’origine en de nombreux petits modules experts. Pendant l’inférence, un mécanisme de routage sélectionne automatiquement les k meilleurs experts pour chaque jeton, évitant ainsi d’exécuter tous les experts. En plus des experts routés, un petit nombre d’experts partagés restent toujours actifs, capturant des connaissances générales inter-domaines. Le mécanisme de routage MoE fonctionne comme suit : les experts partagés empêchent chaque expert routé d’apprendre de manière redondante des bases comme la grammaire et le raisonnement élémentaire. Le projet propose sept configurations prédéfinies, allant de 1B à 1T de paramètres, répondant à divers besoins, de l’expérimentation à la production. Des scripts d’entraînement sont également fournis, prenant en charge l’entraînement sur un seul GPU et distribué sur plusieurs GPU.

Cependant, OpenMythos a également suscité des controverses dans la communauté. Les partisans y voient un travail pionnier : la première implémentation complète d’un Recurrent-Depth Transformer, basée sur plusieurs articles de premier plan, fournissant du code PyTorch exécutable et des outils pour que la communauté explore de nouvelles architectures. Les critiques soulignent qu’il ne s’agit que d’une implémentation architecturale sans poids pré-entraînés, nécessitant des ressources massives pour un entraînement à partir de zéro ; il est incertain qu’elle ressemble vraiment à l’architecture de Claude Mythos ; et l’auteur, Kye Gomez, a des antécédents avec la série de projets Open-X, que certains considèrent comme du marketing pour des alternatives open source aux modèles propriétaires. Ce n’est pas exactement trompeur – le README indique clairement qu’il s’agit d’une reconstruction théorique sans aucun lien avec Anthropic. Mais la façon dont il s’est propagé… fait écho à la controverse entourant Claude Mythos lui-même. Anthropic a restreint la publication publique de Mythos pour des raisons de sécurité, mais les critiques estiment que cela peut élargir le fossé technologique. Par ailleurs, la valeur d’OpenMythos doit être validée par des résultats d’entraînement réels, et non par de simples affirmations théoriques.

Bien sûr, OpenMythos a ses propres limites. Sans poids pré-entraînés, il nécessite un entraînement à partir de zéro, ce qui constitue une barrière élevée. Les modèles à grande échelle (100B+ paramètres) nécessitent un entraînement distribué, et la gestion de contextes longs (1M jetons) demande une mémoire substantielle. Bien que la contrainte LTI stabilise théoriquement l’entraînement et réduise les fluctuations, son efficacité pratique doit être confirmée par des tests approfondis. De plus, plus de boucles n’est pas toujours mieux – une profondeur excessive peut conduire à une sur-réflexion et un sur-raisonnement, nuisant finalement à la précision des prédictions.

Enfin, une réflexion : auparavant, découvrir l’architecture de Claude Mythos n’était que spéculation. Avec Anthropic retenant les détails techniques, la communauté ne pouvait qu’assembler des indices à partir de la System Card. OpenMythos représente quelqu’un qui transforme des articles théoriques en code exécutable, rendant les hypothèses abstraites testables. Lorsque les capacités de l’IA atteignent un certain seuil, la décision de publier ou de retenir peut être plus difficile que le défi technique lui-même. OpenMythos en est encore à ses débuts, manquant de poids pré-entraînés et nécessitant un entraînement à partir de zéro. Mais la direction est bonne – donner à la communauté une chance d’explorer de nouvelles architectures plutôt que d’attendre des versions officielles. Si vous vous intéressez aux Recurrent-Depth Transformers, essayez d’exécuter un exemple minimal pour expérimenter le raisonnement itératif. Le projet est ouvert sous licence MIT. Consultez le dépôt GitHub pour le code source et la documentation.

Adresse du projet : https://github.com/kyegomez/OpenMythos